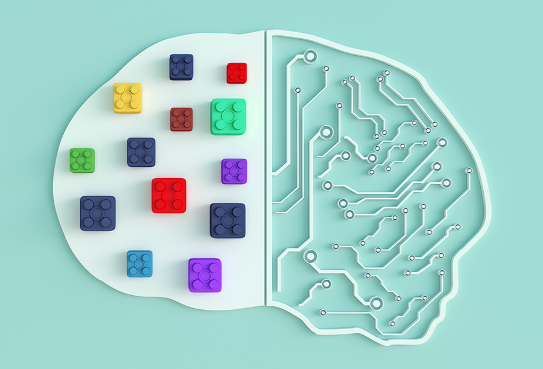

像任何新技术一样,人工智能能够产生巨大的好坏。公众似乎越来越关注坏处,尤其是在谈到AI的潜在偏见时。这种担忧是有充分根据的,也是有据可查的。但是什么是AI?它是机器对人类过程的模拟。这种对有偏见的AI的恐惧忽略了一个关键事实:AI产生偏见的最深层次原因是它正在模拟的人类行为。它是用于训练算法的有偏见的数据集。如果您不喜欢AI所做的事情,那么您肯定会不喜欢人类的所作所为,因为AI纯粹是在向人类学习。

让我们专注于招聘。招聘的现状存在严重缺陷,坦率地说,反乌托邦主义的原因主要有三个。

无意识的人为偏见使招聘变得不公平。在面试之前对申请人进行审查的典型方法是通过招聘人员对简历进行审查。大量研究表明,这一过程导致对妇女,少数民族和老年工人的重大无意识偏见。

申请人大池被忽略。LinkedIn和其他采购平台非常成功,平均有250名申请人申请任何公开职位。这转化为数以千计的公开职位申请者。显然,此过程无法手动处理。因此,招聘人员将他们对申请人池的审查限制在他们认为将显示出最大希望的10%到20%:来自常春藤盟校区的人才,寻求填补职位的公司竞争对手的被动应聘者或员工推荐计划。但猜猜怎么了?与提交简历的申请人数量相比,顶尖的大学和员工推荐计划的多样性要少得多。

传统的招聘工具已经偏向。这是由美国法律的一个漏洞允许的:联邦法律声明,如果是与工作相关的租用工具可以偏颇。“与工作相关”是指成功完成某个角色的人具有某些特征。但是,如果所有“成功的员工”都是白人,由于人类在聘用习惯上的偏见,那么几乎可以肯定的是,与工作相关的聘用评估将偏向于白人,而不是白人和白人。来自非常春藤盟校的一名非洲裔美国妇女很幸运地成为了人才的一部分,其简历得到了审查,并且通过了招募人员评估她的简历的候选人,然后可能会被要求进行有偏见的评估。

难怪我们要雇用多样化的劳动力吗?导致当今长期缺乏多样性的因素以及将继续阻碍多样性的因素是当今存在的人类范式,而不是人工智能。

人工智能最大的希望是消除招聘偏见,其主要原因有两个:

1.人工智能可以消除无意识的人类偏见。当前许多用于招聘的AI工具都有缺陷,但是可以解决。AI的优点在于我们可以设计它以满足某些有益的规范。像OpenAI和未来人生研究院这样的AI从业者之间的运动已经提出了一套设计原则,以使AI符合道德规范和公平(即,对所有人有利)。一个关键原则是应设计AI,以便对其进行审核并消除其中的偏见。AI审核的功能应与新车开车前的安全测试一样。如果不符合标准,则必须先修复有缺陷的技术,然后才能将其投入生产。

2. AI可以评估候选人的整个流程,而不是强迫时间紧迫的人员实施有偏见的流程以从一开始就缩小流程。只有使用真正的自动化漏斗处理程序,我们才能消除因收缩初始管道而造成的偏差,因此手动招聘人员的能力可以处理它。令人震惊的是,如今的公司毫不掩饰地承认,数以百万计的申请者中只有一小部分受到审查。技术人员和立法者应共同努力,创建工具和政策,使对整个管道的审查成为可能和强制性。

此外,对AI公平性的关注应该使我们以相同的标准评估现有的聘前评估。美国平等就业机会委员会(EEOC)于1970年代制定了现行的公平招聘条例,当时公共互联网问世,而申请每种工作的人数激增。EEOC没想到现代算法比人类更容易偏见,但也能够评估更大,更多样化的管道。我们需要更新和阐明这些规定,以真正鼓励招聘中的机会均等,并允许使用符合明确标准的算法招聘系统。标准的一些先例已经出现。加利福尼亚州议会通过决议为了使用公正的技术来促进招聘的多样性,旧金山DA在刑事司法程序中使用了“盲判”人工智能。

相同的标准应适用于现有的招聘工具。亚马逊因其男性偏见的招聘算法而在全国范围内受到了沉重的打击。然而在当今的美国,法律上允许雇主使用歧视妇女或少数族裔的传统偏见评估。怎么会这样?可能是因为大多数人不知道偏见的评估被广泛使用(和合法)。如果我们要呼吁无偏的AI(我们绝对应该这样做),我们还应该呼吁消除所有有偏见的传统评估。

教育新闻网

教育新闻网