智能机器灾难性地误解人类的愿望是科幻小说中的一个常见说法,也许最能令人回味地用在艾萨克·阿西莫夫(Isaac Asimov)的机器人故事中,这些故事曲解了著名的“机器人三定律”。人工智能出现问题的想法与人类对技术的恐惧共鸣。但是,当前关于超人AI的讨论受到关于智能本质的错误直觉的困扰。

我们不需要一直回到艾萨克·阿西莫夫(Isaac Asimov)的路上-最近有很多关于这种恐惧的例子。参加《纽约时报》的操作编辑和计算机科学家Stuart Russell撰写的新书“ Human Compatible”。罗素认为,如果我们对人工智能的设计不谨慎,就会冒着创造“超智能”机器的风险,这些机器的目标与我们自己的目标不完全一致。

作为目标不一致的一个例子,拉塞尔问道:“鉴于将二氧化碳浓度恢复到工业化前水平的工作,超级智能气候控制系统认为解决方案是将人口减少到零吗?”我们将错误的物镜插入机器,它比我们更智能,我们会失去。”

罗素的观点扩展了哲学家尼克·博斯特罗姆(Nick Bostrom)的论点,后者将AI超级智能定义为“在几乎每个领域,包括科学创造力,一般智慧和社交技能,其智慧都比人类最好的大脑要聪明得多。”与当今最好的机器不同,后者Bostrom和Russell认为,除了相对狭窄的领域(例如下棋或围棋)以外,所有领域的人类智能水平都远远低于人类。

Bostrom,Russell和其他作家认为,即使在可预见的将来出现这种超级智能机器的可能性很小,这也是一个如此巨大和潜在危险的事件,我们现在应该开始为此做好准备。在博斯特罗姆看来,“机器超级智能的产生的一个可能的默认结果就是生存灾难。”也就是说,人类将敬酒。

这些思想家(我们称它们为“超级情报”)推测,如果机器要获得一般的人类智能,机器将很快成为超级情报。他们推测,具有一般智能的计算机将能够快速读取所有现有的书籍和文档,从而吸收人类的全部知识。同样,机器将能够利用其逻辑能力进行发现,从而增加其认知能力。

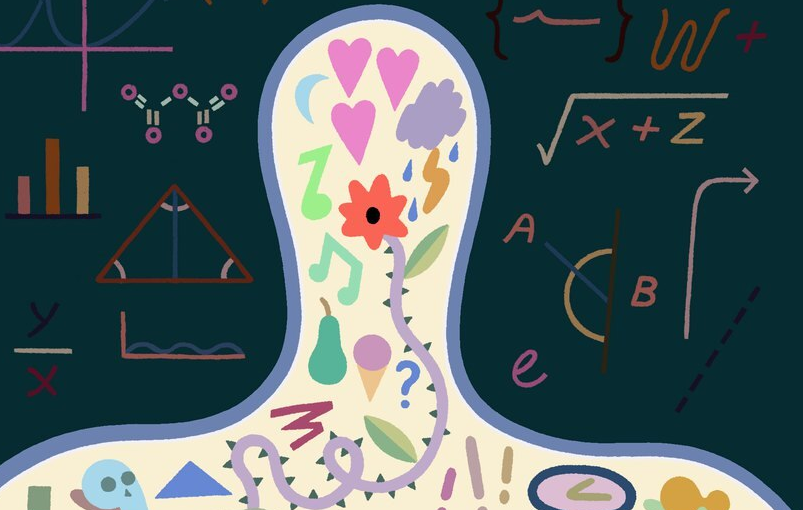

人们猜测,这种机器不会受到人类烦恼的限制,例如思想迟缓,情绪低落,不合理的偏见和睡眠需求。取而代之的是,该机器将具有类似“纯粹”的智能,而没有任何限制人类的认知缺陷。

假设似乎是这种AI可以超越人类智能的通用性和灵活性,同时无缝保留计算机的速度,精度和可编程性。这个想象中的机器将比任何人类都要聪明得多,在“一般智慧和社交技能”方面也要好得多,但与此同时,它将保留不受限制地使用其所有机械功能的机会。正如罗素的例子所示,它将缺乏人性化的常识。

这种预测的问题在于它们低估了一般的,人类水平的情报的复杂性。人类情报是一个高度集成的系统,它的许多属性(包括情绪,欲望以及强烈的自我意识和自治能力)无法轻易分离。

同样,如果创建了一般的智能AI(需要数十年,甚至几个世纪的时间),它的目标就不会像我们的目标那样容易地“插入”或“统一”。它们宁可与其他品质一起发展融入人类社会和文化,从而形成其智慧。机器实现其目标的努力将受到常识,价值观和社会判断力的制约,而没有这些知识,就不会存在一般的智慧。

教育新闻网

教育新闻网